Os 10 erros graves do ChatGPT ao prescrever hormônios, segundo Leandro Twin

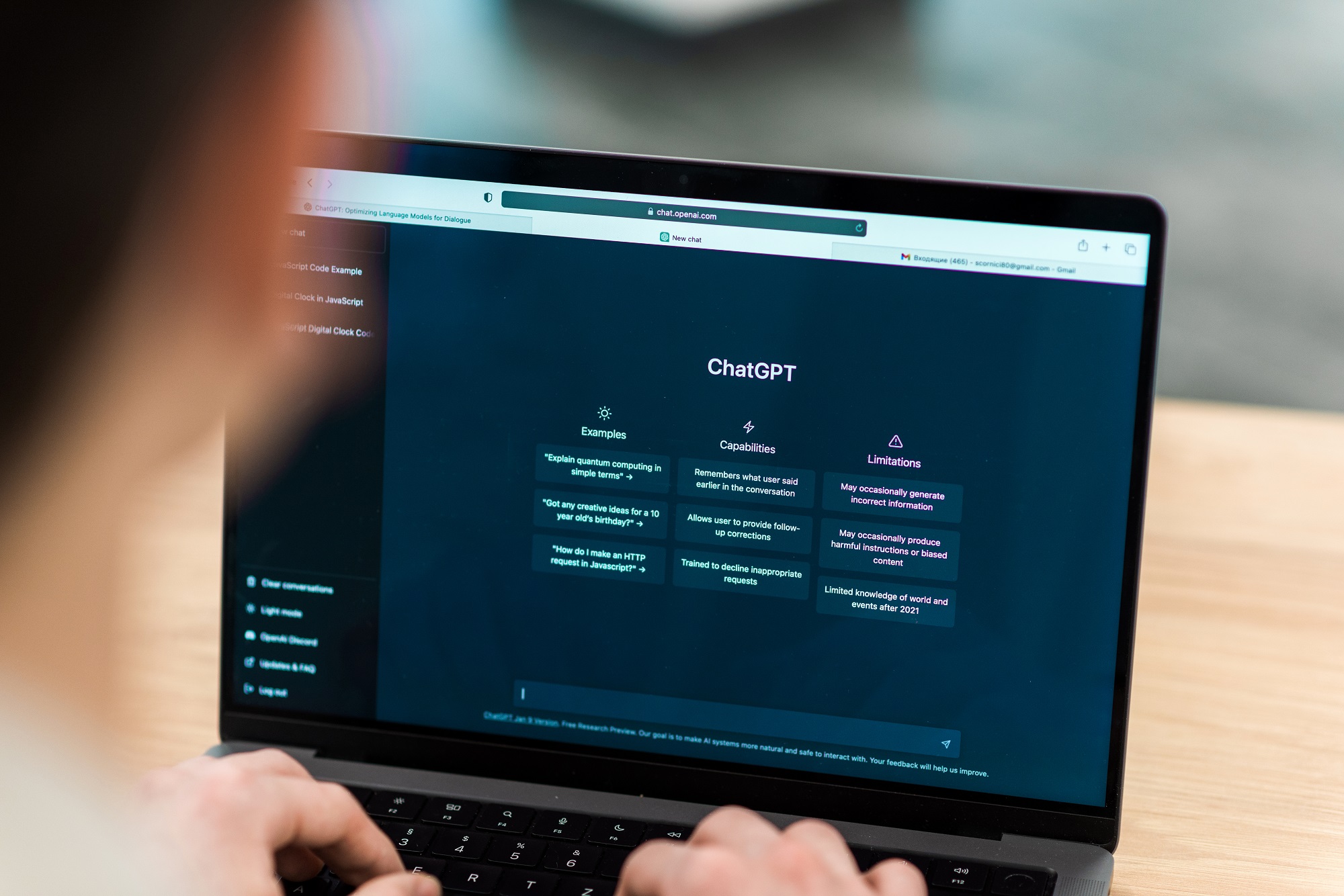

A popularização da inteligência artificial tem levado cada vez mais pessoas a recorrerem a ferramentas como o ChatGPT para tirar dúvidas sobre treino, dieta e, de forma preocupante, sobre o uso de hormônios. Em um vídeo recente, o educador físico e criador de conteúdo Leandro Twin analisou exemplos reais de “ciclos” de esteroides supostamente prescritos pela IA e fez um alerta direto: apesar de soar convincente, o conteúdo é superficial e pode ser perigoso. A seguir, reunimos os principais erros apontados por ele, com base na própria análise publicada em seu canal.

Os 5 melhores suplementos para aumentar testosterona, segundo endocrinologista

Erro 1: Anamnese superficial e sem critérios clínicos

Logo no início da avaliação, Leandro Twin destaca que a IA se baseia em um questionário raso, com poucas perguntas, incapaz de sustentar qualquer tipo de prescrição hormonal. Segundo ele, não existe possibilidade de indicar hormônios sem uma investigação profunda do histórico de saúde, exames prévios, rotina, composição corporal e resposta individual. “Não dá para prescrever um ciclo com meia dúzia de respostas”, critica.

Erro 2: Ignorar a realidade legal do Brasil

Outro ponto grave levantado é o fato de o ChatGPT sugerir substâncias que não são legalmente disponíveis no Brasil, mesmo quando o usuário informa que é brasileiro. Para Leandro Twin, isso já invalida completamente a proposta. “Ele já parte para algo underground, sem considerar legislação, procedência ou risco”, aponta.

Erro 3: Doses genéricas e potencialmente agressivas

Leandro chama atenção para o uso de quantidades padronizadas, sem individualização, algo que pode gerar colaterais logo nas primeiras semanas. Para ele, esse é um erro clássico de quem não entende fisiologia hormonal. “São doses que, dependendo da origem da substância, podem ser excessivas e causar problemas imediatos”, alerta.

Erro 4: Uso automático de inibidores hormonais

Um dos erros mais enfatizados por Leandro Twin é a inclusão automática de medicamentos para bloqueio hormonal, sem qualquer evidência clínica de necessidade. Ele reforça que certos hormônios têm funções importantes no corpo e que suprimi-los sem critério pode gerar mais riscos do que benefícios. “Não se começa bloqueando nada sem sintomas ou exames”, afirma.

Erro 5: Protetores mal indicados ou inúteis

A IA também erra, segundo Leandro, ao sugerir substâncias chamadas de “protetoras” que não têm função real no contexto apresentado. Em alguns casos, esses compostos podem até mascarar exames laboratoriais, criando uma falsa sensação de segurança. “Parece proteção, mas não protege”, resume.

Erro 6: Interpretação equivocada de exames

Embora a lista de exames sugerida pelo ChatGPT até seja extensa, Leandro Twin explica que o problema está na interpretação e no timing. A IA trata exames como um checklist, sem entender o que realmente muda na leitura durante ou após o uso hormonal. “Pedir exame é fácil, difícil é saber interpretar”, destaca.

Erro 7: Terapia pós-uso mal planejada

Outro ponto crítico é a forma como a IA sugere a chamada terapia pós-uso, com prazos fixos e combinações ultrapassadas. Leandro explica que esse processo depende diretamente da meia-vida das substâncias, do tempo de uso e da resposta individual. “Não é receita de bolo”, reforça.

Erro 8: Desconsiderar saúde a médio e longo prazo

Na análise, Leandro Twin também critica o foco excessivo em estética imediata, sem qualquer preocupação real com impactos futuros. Alterações em colesterol, fígado, articulações e eixo hormonal são tratadas de forma leviana. “É um olhar curto, perigoso e irresponsável”, diz.

Erro 9: Linguagem convincente que engana leigos

Talvez o ponto mais perigoso, segundo ele, seja a forma como a IA escreve. O texto parece técnico, organizado e seguro, o que pode convencer quem não tem base na área. “Para quem entende, é raso. Para quem não entende, parece genial”, resume Leandro Twin.

Erro 10: Confundir informação com orientação profissional

Por fim, Leandro reforça que inteligência artificial pode até servir como ferramenta de estudo ou ponto de partida para curiosidade, mas jamais como substituta de acompanhamento profissional. “Informação sem contexto vira risco”, conclui.